KI-Sprachassistent: Hören. Verstehen. Antworten. Alles lokal.

Sprachgesteuerte KI ohne Cloud — Whisper + lokales LLM + TTS in einer Pipeline

🗣️ Ihr eigener Sprachassistent. Privat. Lokal. Offline.

💰 Warum ein lokaler Sprachassistent einen echten Unterschied macht

Alexa, Siri & Co. senden jedes gesprochene Wort an Cloud-Server. Für Arztpraxen, Anwaltskanzleien und Unternehmen mit sensiblen Daten ist das undenkbar. KIAgent_redet beweist: Hochwertige Sprachinteraktion funktioniert komplett lokal — in Echtzeit, ohne Datenabfluss.

⚙️ So funktioniert's

Die dreistufige Pipeline: Sprechen → Verstehen → Antworten — vollständig lokal.

💻 Technische Umsetzung

KIAgent_redet kombiniert drei bewährte Open-Source-Komponenten zu einer nahtlosen Sprachpipeline. Der gesamte Stack läuft lokal — keine API-Keys, keine Cloud-Kosten, keine Latenz.

🏗️ Architektur-Komponenten

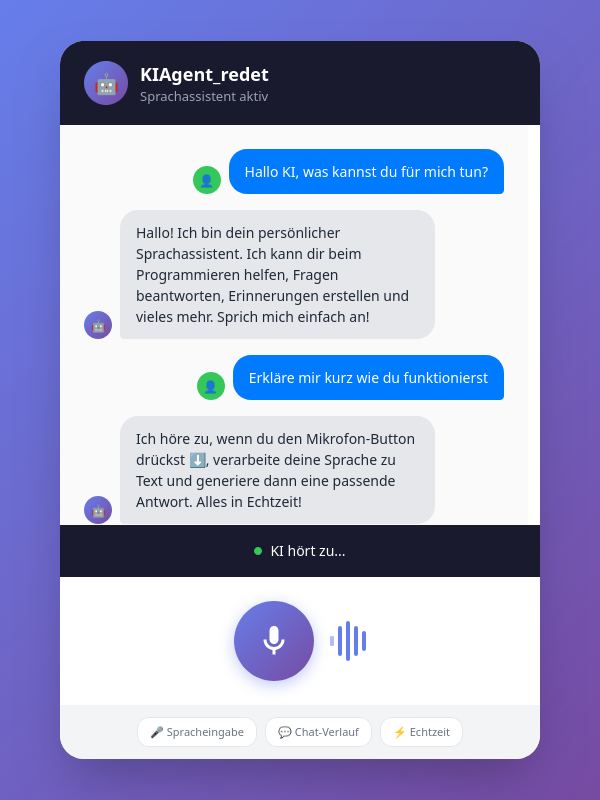

📸 Screenshot

📊 Projekt-Status

✅ Funktional

KIAgent_redet ist einsatzbereit und läuft stabil auf einem Windows-Rechner mit RTX 3060.

⚡ In 5–7 Tagen zu Ihrem lokalen Sprachassistenten.

🚀 Gebaut mit Vibecoding — in Tagen statt Wochen

- 📋 2–3 Wochen Requirements Engineering

- 🏗️ 2–3 Wochen Architektur & Design

- 💻 3–4 Wochen Implementierung

- 🧪 1–2 Wochen Testing

- 🚢 1 Woche Deployment

- ⏱️ Gesamt: 8–13 Wochen

- 🗣️ 0.5 Tage Prompt-Engineering

- ⚡ 2–3 Tage iterative Generierung

- 🔧 1–2 Tage Refinement & Debugging

- ✅ 1 Tag Integration & Testing

- 🚀 0.5 Tage Deployment

- ⏱️ Gesamt: 5–7 Tage

🗣️ Der System-Prompt hinter diesem Projekt

Der Prompt, der aus drei Einzelteilen einen sprechenden KI-Assistenten machte:

Du bist ein Experte für Sprachverarbeitungs-Pipelines in Python. Aufgabe: Erstelle einen sprachgesteuerten KI-Assistenten, der komplett lokal läuft — ohne Cloud-Dienste. Pipeline: 1. Mikrofon-Aufnahme → Whisper STT (Transkription) 2. Transkribierter Text → Lokales LLM (Ollama) zur Verarbeitung 3. LLM-Antwort → TTS-Engine (Sprachausgabe) Technische Anforderungen: - Whisper (OpenAI) lokal für Speech-to-Text - Ollama für lokales LLM-Hosting - Edge-TTS oder Piper TTS für deutsche Sprachausgabe - Endlosschleife: Zuhören → Verstehen → Antworten → Zuhören - Error-Handling für Mikrofon-Fehler, leere Aufnahmen Wichtig: - Alles lokal — kein gesprochenes Wort verlässt den Rechner - Deutsche Sprache priorisieren (Whisper language=de) - Kontext über mehrere Runden erhalten - Ressourcen-Management (GPU-Speicher für Whisper + LLM)

🎯 Strategische Erkenntnisse aus diesem Projekt

Sprachinteraktion ist die natürlichste Mensch-Maschine-Schnittstelle. Diese Erkenntnisse sind richtungsweisend für jede sprachbasierte KI-Anwendung.

Bereit für einen Assistenten, der wirklich zuhört?

Sprach-KI muss keine Daten an Cloud-Server senden. Wir bauen Ihren Assistenten — lokal, privat, exakt auf Ihre Bedürfnisse zugeschnitten.